A törvény háttere

Az EU AI Actet 2021 áprilisában terjesztette elő az Európai Bizottság, és a három EU intézmény politikailag megállapodott róla 2023 decemberében. A 2023 decemberében a tagállamokkal folytatott tárgyalásokon elfogadott rendeletet a képviselők 523 igen szavazattal, 46 nemmel és 49 tartózkodással támogatták. A törvény várhatóan 2024 június közepén lép hatályba, miután az Európai Parlament megszavazza és közzéteszik az Európai Unió Hivatalos Lapjában.

A törvény céljai és jelentősége

Az EU AI Act célja, hogy ösztönözze a megbízható és felelősségteljes MI fejlesztést és alkalmazást, miközben védelmet nyújt a polgárok számára. Ez a szabályozás fontos lépés az MI technológiák biztonságos és etikus felhasználásának biztosítása felé, és egyben hozzájárul az EU digitális piacának megerősítéséhez is. Az MI rendszerek fejlesztői és felhasználói számára világos irányelveket és követelményeket határoz meg, amelyek betartása hosszú távon elősegíti a technológiai innováció és a társadalmi bizalom egyensúlyának fenntartását.

Az EU Mesterséges Intelligencia Törvény tehát alapvetően meghatározza a jövőbeni MI fejlesztési és alkalmazási normákat az Európai Unióban, és példát mutat a világ többi részének is a mesterséges intelligencia biztonságos és felelősségteljes használatában.

Kinek kell megfelelnie?

Az EU AI Act azokra a vállalkozásokra vonatkozik, amelyek MI rendszereket helyeznek forgalomba az EU-ban, vagy amelyek rendszereinek kimeneteit az EU-ban használják, függetlenül attól, hogy hol fejlesztették vagy üzemeltetik azokat. Ez a szabályozás tehát a nem európai vállalatokra is hatással van, amennyiben azok MI rendszereinek eredményeit az EU-ban használják.

A törvény főbb követelményei

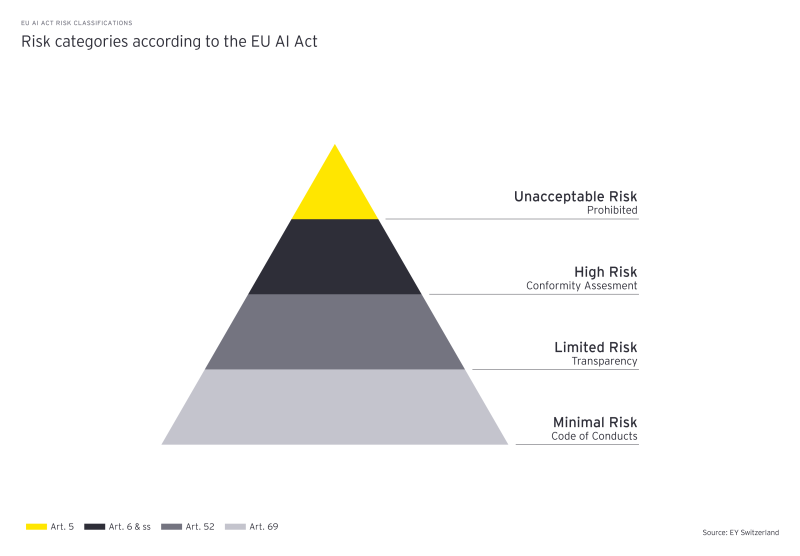

Az AI rendszereket kockázatuk alapján osztályozzák, és különböző szintű átláthatósági és jelentési kötelezettségek vonatkoznak rájuk. A legjelentősebb követelmények a "magas kockázatú" MI rendszerekre vonatkoznak. A magas kockázatú rendszerek közé tartoznak például a biometrikus azonosító rendszerek, az oktatási és munkaerő-piaci rendszerek, valamint az igazságszolgáltatásban használt rendszerek.

Főbb kötelezettségek:

- Regisztráció: Az MI rendszerek regisztrálása az EU adatbázisában, mielőtt forgalomba hoznák vagy használatba vennék.

- Osztályozás: A magas kockázatú MI rendszerek azonosítása.

- Kockázatkezelés: Megfelelő és célzott kockázatkezelési intézkedések bevezetése.

- Adatkezelés: Magas minőségű képzési adatok használatának biztosítása, adatkezelési gyakorlatok betartása, releváns és elfogulatlan adathalmazok biztosítása.

- Technikai dokumentáció: Az MI rendszer megfelelőségének értékeléséhez szükséges információk rögzítése és nyilvántartása.

- Emberi felügyelet: Ember-gép interfész eszközök integrálása a kockázatok minimalizálása érdekében.

- Pontosság, robusztusság és biztonság: Az MI rendszer életciklusa során következetes pontosság, robusztusság és kiberbiztonsági intézkedések biztosítása.

- Minőségirányítás: Magas kockázatú MI rendszerek szolgáltatóinak minőségirányítási rendszert kell működtetniük.

- EU megfelelőségi nyilatkozat: Megfelelőségi nyilatkozat elkészítése és naprakészen tartása.

- CE jelölés: Biztosítani kell a CE jelölés jól látható, olvasható és kitörölhetetlen módon való feltüntetését.

- Eseményjelentés: Súlyos incidensek jelentése az illetékes hatóságoknak.

Tiltott alkalmazások

Az új szabályok betiltanak bizonyos mesterséges intelligencia alkalmazásokat, amelyek veszélyeztetik az állampolgárok jogait, ideértve az érzékeny jellemzőken alapuló biometrikus kategorizáló rendszereket, valamint az arcképek internetről vagy CCTV-felvételekről való céltalan lekaparását arcfelismerő adatbázisok létrehozásához. Ugyancsak tilos lesz az érzelmek felismerése a munkahelyen és az iskolákban, a társadalmi pontozás, a prediktív rendfenntartás (amikor kizárólag egy személy profilalkotásán vagy tulajdonságainak felmérésén alapul), valamint az emberi viselkedést manipuláló vagy az emberek sebezhetőségét kihasználó mesterséges intelligencia.

Bűnüldözési mentességek

A biometrikus azonosítási rendszerek (RBI) bűnüldöző szervek általi használata elvileg tilos, kivéve a kimerítően felsorolt és szűken meghatározott helyzeteket. A „valós idejű” RBI csak szigorú biztosítékok betartása esetén alkalmazható, például használata időben és földrajzilag korlátozott, és előzetes bírósági vagy közigazgatási engedélyhez kötött. Ilyen felhasználások lehetnek például egy eltűnt személy célzott felkutatása vagy terrortámadás megelőzése. Az ilyen rendszerek utólagos használata („post-remote RBI”) nagy kockázatú felhasználási esetnek minősül, amely bűncselekményhez kötött bírósági engedélyt igényel.

A magas kockázatú rendszerek kötelezettségei

Egyértelmű kötelezettségeket irányoztak elő más magas kockázatú mesterséges intelligencia rendszerekre is (az egészségre, a biztonságra, az alapvető jogokra, a környezetre, a demokráciára és a jogállamiságra gyakorolt jelentős potenciális károk miatt). A magas kockázatú mesterséges intelligencia használatára példák a kritikus infrastruktúra, az oktatás és a szakképzés, a foglalkoztatás, az alapvető magán- és közszolgáltatások (pl. egészségügy, banki szolgáltatások), bizonyos rendészeti rendszerek, migráció és határigazgatás, igazságszolgáltatás és demokratikus folyamatok (pl. választások befolyásolása). Az ilyen rendszereknek fel kell mérniük és csökkenteniük kell a kockázatokat, vezetniük kell a használati naplókat, átláthatóknak és pontosaknak kell lenniük, és biztosítaniuk kell az emberi felügyeletet. A polgároknak jogukban áll panaszt benyújtani az AI rendszerekkel kapcsolatban, és magyarázatot kapni a jogaikat érintő, magas kockázatú mesterséges intelligencia rendszereken alapuló döntéseikről.

Átláthatósági követelmények

Az általános célú mesterséges intelligencia (GPAI) rendszereknek és az ezeken alapuló GPAI modelleknek meg kell felelniük bizonyos átláthatósági követelményeknek, beleértve az EU szerzői jogi törvényeinek való megfelelést és a képzéshez használt tartalom részletes összefoglalóinak közzétételét. Az erősebb GPAI modellek, amelyek rendszerszintű kockázatokat jelenthetnek, további követelményekkel szembesülnek majd, ideértve a modellértékelések elvégzését, a rendszerkockázatok értékelését és mérséklését, valamint az incidensek jelentését. Ezenkívül a mesterséges vagy manipulált képeket, hang- vagy videótartalmat („mélyhamisítás”) egyértelműen meg kell jelölni.

Bírságok

A törvény szigorú bírságokat helyez kilátásba a nem megfelelés esetére:

- A tiltott MI rendszerek használata miatt akár az éves globális árbevétel 7%-áig vagy 35 millió euróig terjedő bírság.

- Más szabálysértések esetén az éves globális árbevétel 3%-áig vagy 15 millió euróig terjedő bírság.

- Téves információk szolgáltatása esetén az éves globális árbevétel 1,5%-áig vagy 7,5 millió euróig terjedő bírság.

Következő lépések avagy mit hoz a jövő?

Az EU mesterséges intelligencia törvény bevezetésével új korszak kezdődik a technológiai fejlesztések és alkalmazások terén. A felhasználók számára ez azt jelenti, hogy a jövőben több átláthatóságra és biztonságra számíthatnak az MI rendszerek használatában. Az érintett vállalkozásoknak fontos, hogy megismerjék és alkalmazkodjanak az új szabályozásokhoz, amelyek célja a magasabb szintű védelem és megbízhatóság biztosítása. Az átállási időszak alatt kiemelten fontos a folyamatos tájékozódás és a szükséges megfelelési lépések megtétele.